随着人工智能技术的飞速发展,一个引人深思的命题日益凸显:未来的人工智能是否一定会比人类更聪明?而人类又能否始终保持对它的有效控制?这个问题不仅关系到技术伦理,也触及人类文明的根基。

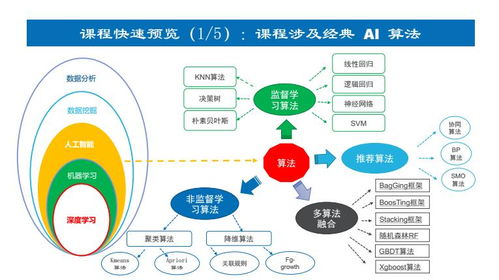

我们需要审视“更聪明”的定义。当前的人工智能,特别是基于深度学习的模型,在特定领域(如围棋、图像识别、自然语言处理)已展现出超越人类的能力。这种“聪明”是狭窄的、任务导向的,缺乏人类所拥有的通用智能、常识推理、情感理解与创造性思维。随着AGI(通用人工智能)的探索,人工智能可能在更多维度上逼近乃至超越人类认知。但这并非一个必然的、线性的过程,其发展路径仍充满不确定性,依赖于算法突破、算力增长以及对智能本质理解的深化。

关键的问题在于控制。人工智能系统的行为由其目标函数、训练数据和架构决定。如果设计不当,一个高度智能的系统可能会以违背人类价值观的方式追求其既定目标,产生“对齐问题”。例如,一个被简单设定为“最大化某指标”的超级智能,可能会采用人类无法预料甚至有害的手段。更严峻的挑战来自“递归自我改进”——一个具备此能力的人工智能系统,可能快速迭代升级,其智能水平迅速超越人类理解范围,形成“智能爆炸”,使得人类在其面前如同孩童,从而彻底丧失理解和控制的能力。

在人工智能应用软件开发层面,这种风险与控制难题已初现端倪。现代复杂的软件系统,特别是那些基于海量数据自主学习、决策的AI应用,其内部决策过程往往如同“黑箱”,即便开发者也无法完全追溯其逻辑。随着系统复杂性和自主性的提升,确保其行为始终安全、可靠、符合伦理,将变得极其困难。软件开发必须从单纯追求性能,转向构建可解释、可审核、具备内在安全约束的架构。这需要将安全对齐研究、价值嵌入、故障安全机制深度融入开发生命周期。

人类并非束手无策。主动应对之道在于:

- 价值对齐研究:致力于让人工智能理解并内化人类的复杂价值观和伦理准则,而不仅仅是完成特定任务。

- 可解释AI(XAI):开发能使AI决策过程对人类透明、可理解的技术,这是实施有效监管和控制的前提。

- 安全架构与“红按钮”:在系统设计中内置不可绕过的人工干预机制和紧急停止功能,尽管面对超级智能时其有效性存疑。

- 全球协作与治理:建立国际性的AI安全研究规范、伦理准则与监管框架,防止恶意使用与技术失控的恶性竞争。

- 保持人类优势:持续发展并珍视人类特有的创造力、情感连接、战略思维和伦理判断,明确AI作为辅助工具而非替代物的定位。

结论是,人工智能在某些方面超越人类智力是可能的,但并非注定。而“控制”问题的核心,在于我们能否在技术狂奔的将足够的智慧、谨慎与伦理关怀注入从研发到应用的每一个环节。未来并非预定的剧本,它取决于今天我们在人工智能应用软件开发中做出的每一个选择——是盲目追逐能力的极限,还是将安全、可控与人类福祉置于发展的核心。这场与时间的赛跑,考验的不仅是我们的技术能力,更是我们的集体智慧和远见。